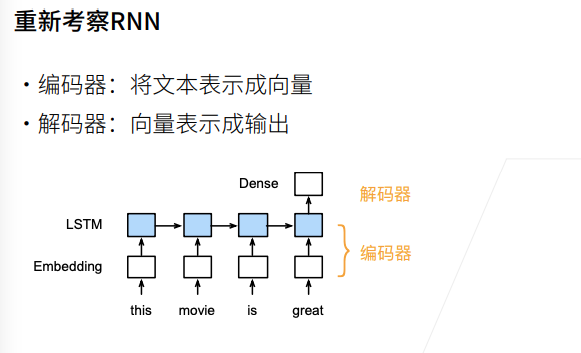

回忆编码器的架构:

编码器就是一个 RNN 结构,只不过这个编码器的初始状态为 0,传给解码器的就是 RNN 的输出和这个序列最终的状态:

#@save

class Seq2SeqEncoder(d2l.Encoder):

"""用于序列到序列学习的循环神经网络编码器"""

def __init__(self, vocab_size, embed_size, num_hiddens, num_layers,

dropout=0, **kwargs):

super(Seq2SeqEncoder, self).__init__(**kwargs)

# 嵌入层

self.embedding = nn.Embedding(vocab_size, embed_size)

self.rnn = nn.GRU(embed_size, num_hiddens, num_layers,

dropout=dropout)

def forward(self, X, *args):

# 输出'X'的形状:(batch_size,num_steps,embed_size),和前面的数据集一致

X = self.embedding(X)

# 在循环神经网络模型中,第一个轴对应于时间步

X = X.permute(1, 0, 2)

# 如果未提及状态,则默认为0

output, state = self.rnn(X)

# output的形状:(num_steps,batch_size,num_hiddens)

# state的形状:(num_layers,batch_size,num_hiddens)

return output, state

state 表示 state 为 0嵌入层与 one-hot 类似,作用是将大量的类别输入(比如单词、标签或其他类别的特征)转换成稠密的向量表示,与 one-hot 不同,one-hot 太粗糙,向量太稀疏,嵌入层更稠密

self.embedding(X) 和 one-hot 类似([[8.5 循环神经网络的从零开始实现#^8162e4]]),经过嵌入之后会在后面加一个维度,变成(批量大小,时间步数,嵌入维度),为了匹配内置 RNN 的输入,所以第 0 维和第 1 维要交换(X.permute(1, 0, 2))

rnn 的输出是和嵌入维度无关的,因为最终会转化为隐藏层大小

encoder = Seq2SeqEncoder(vocab_size=10, embed_size=8, num_hiddens=16,

num_layers=2)

encoder.eval()

X = torch.zeros((4, 7), dtype=torch.long)

output, state = encoder(X)

output.shape # torch.Size([7, 4, 16])

state.shape # torch.Size([2, 4, 16])

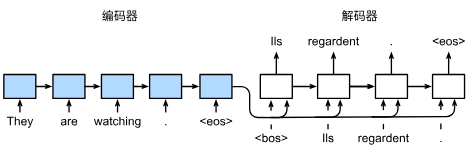

解码器利用编码器传过来的状态作为初始状态,与普通 RNN 链不同的是,解码的时候利用了编码器的状态与当前输入进行 cat,当做 rnn 的输入:

编码器就是一个普通的 rnn,解码器每次输入上一个时间步的词,和编码器传过来的状态(对每个时间步是一样的)

编码器就是一个普通的 rnn,解码器每次输入上一个时间步的词,和编码器传过来的状态(对每个时间步是一样的)

class Seq2SeqDecoder(d2l.Decoder):

"""用于序列到序列学习的循环神经网络解码器"""

def __init__(self, vocab_size, embed_size, num_hiddens, num_layers,

dropout=0, **kwargs):

super(Seq2SeqDecoder, self).__init__(**kwargs)

self.embedding = nn.Embedding(vocab_size, embed_size)

self.rnn = nn.GRU(embed_size + num_hiddens, num_hiddens, num_layers,

dropout=dropout)

self.dense = nn.Linear(num_hiddens, vocab_size)

def init_state(self, enc_outputs, *args):

return enc_outputs[1]

def forward(self, X, state):

# 输出'X'的形状:(batch_size,num_steps,embed_size)

X = self.embedding(X).permute(1, 0, 2)

# 广播context,使其具有与X相同的num_steps

context = state[-1].repeat(X.shape[0], 1, 1)

X_and_context = torch.cat((X, context), 2)

output, state = self.rnn(X_and_context, state)

output = self.dense(output).permute(1, 0, 2)

# output的形状:(batch_size,num_steps,vocab_size)

# state的形状:(num_layers,batch_size,num_hiddens)

return output, state

state 的维度是(隐藏层数,批量大小,隐藏单元数),state[-1] 表示最后一层的状态,浓缩了编码器所有的信息,state[-1] 维度为(批量大小,隐藏单元数),.repeat 表示对每个时间步都复制同样的状态作为输入,使得 state 的维度为(时间步,批量大小,隐藏单元数)cat 操作作为 rnn 的输入,所以:RNN 的参数为(输入的特征数,隐藏单元数,层数)= (embed_size + num_hiddens,隐藏单元数,层数)(第七行)

context: (时间步,批量大小,隐藏单元数)X: (时间步,批量大小,embed_size)X_and_context:(时间步,批量大小,embed_size + 隐藏单元数)self.dense 是一个全连接层(nn.Linear),这里的 output 是 (时间步,批量大小,隐藏单元),全连接层会对输入的 x 的最后一个维度进行线性变换,变为

decoder = Seq2SeqDecoder(vocab_size=10, embed_size=8, num_hiddens=16,

num_layers=2)

decoder.eval()

state = decoder.init_state(encoder(X))

output, state = decoder(X, state)

output.shape, state.shape

# (torch.Size([4, 7, 10]), torch.Size([2, 4, 16]))

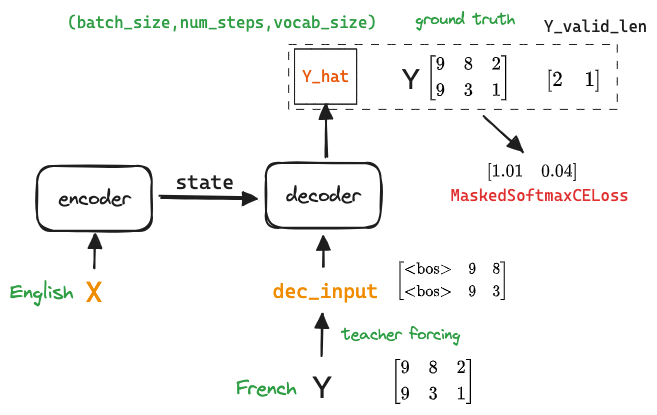

这里继续用交叉熵损失作为损失函数,这里多了个时间步维度,按照 torch 的语法:

在 reduction='none' 情况下,输出的是(批量大小,时间步)的张量,在没有任何处理的情况下,每一行表示各个时间步的损失,但有些序列的某些时间步是没有意义的(例如填充'<pad>'), 得到损失张量后需要 mask,才是正确的损失,之后再按照 dim=1 的方向求 mean 或者 sum

可以使用下面的 sequence_mask 函数通过零值化屏蔽不相关的项

#@save

def sequence_mask(X, valid_len, value=0):

"""在序列中屏蔽不相关的项"""

maxlen = X.size(1)

mask = torch.arange((maxlen), dtype=torch.float32,

device=X.device)[None, :] < valid_len[:, None]

X[~mask] = value

return X

X = torch.tensor([[1, 2, 3], [4, 5, 6]])

sequence_mask(X, torch.tensor([1, 2]))

# 第一个批中 [1] 是有效的,第二个批中 [4,5] 是有效的

# 输出:

# tensor([[1, 0, 0],

# [4, 5, 0]])

通过继承 nn.CrossEntropyLoss 类,构造自定义的损失类:

unweighted_lossweightsweighted_loss.mean(dim=1)#@save

class MaskedSoftmaxCELoss(nn.CrossEntropyLoss):

"""带遮蔽的softmax交叉熵损失函数"""

# pred的形状:(batch_size,num_steps,vocab_size)

# label的形状:(batch_size,num_steps)

# valid_len的形状:(batch_size,)

def forward(self, pred, label, valid_len):

weights = torch.ones_like(label)

weights = sequence_mask(weights, valid_len)

self.reduction='none'

unweighted_loss = super(MaskedSoftmaxCELoss, self).forward(

pred.permute(0, 2, 1), label)

weighted_loss = (unweighted_loss * weights).mean(dim=1)

return weighted_loss

loss = MaskedSoftmaxCELoss()

loss(torch.ones(3, 4, 10), torch.ones((3, 4), dtype=torch.long),

torch.tensor([4, 2, 0]))

# tensor([2.3026, 1.1513, 0.0000]) 第三个批 valid_len=0,所以损失为 0

整体框架如下图所示:

seq2seq 整体训练框架

seq2seq 整体训练框架

#@save

def train_seq2seq(net, data_iter, lr, num_epochs, tgt_vocab, device):

"""训练序列到序列模型"""

def xavier_init_weights(m):

if type(m) == nn.Linear:

nn.init.xavier_uniform_(m.weight)

if type(m) == nn.GRU:

for param in m._flat_weights_names:

if "weight" in param:

nn.init.xavier_uniform_(m._parameters[param])

net.apply(xavier_init_weights)

net.to(device)

optimizer = torch.optim.Adam(net.parameters(), lr=lr)

loss = MaskedSoftmaxCELoss()

net.train()

animator = d2l.Animator(xlabel='epoch', ylabel='loss',

xlim=[10, num_epochs])

for epoch in range(num_epochs):

timer = d2l.Timer()

metric = d2l.Accumulator(2) # 训练损失总和,词元数量

for batch in data_iter:

optimizer.zero_grad()

X, X_valid_len, Y, Y_valid_len = [x.to(device) for x in batch]

bos = torch.tensor([tgt_vocab['<bos>']] * Y.shape[0],

device=device).reshape(-1, 1)

dec_input = torch.cat([bos, Y[:, :-1]], 1) # 强制教学

Y_hat, _ = net(X, dec_input, X_valid_len)

l = loss(Y_hat, Y, Y_valid_len)

l.sum().backward() # 损失函数的标量进行“反向传播”

d2l.grad_clipping(net, 1)

num_tokens = Y_valid_len.sum()

optimizer.step()

with torch.no_grad():

metric.add(l.sum(), num_tokens)

if (epoch + 1) % 10 == 0:

animator.add(epoch + 1, (metric[0] / metric[1],))

print(f'loss {metric[0] / metric[1]:.3f}, {metric[1] / timer.stop():.1f} '

f'tokens/sec on {str(device)}')

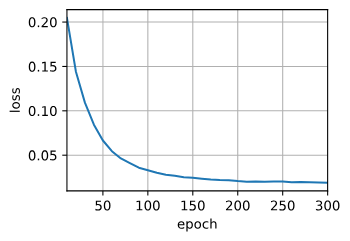

X_valid_len,之后 attention 会用到利用机器翻译数据训练网络:

embed_size, num_hiddens, num_layers, dropout = 32, 32, 2, 0.1

batch_size, num_steps = 64, 10

lr, num_epochs, device = 0.005, 300, d2l.try_gpu()

train_iter, src_vocab, tgt_vocab = d2l.load_data_nmt(batch_size, num_steps)

encoder = Seq2SeqEncoder(len(src_vocab), embed_size, num_hiddens, num_layers,

dropout)

decoder = Seq2SeqDecoder(len(tgt_vocab), embed_size, num_hiddens, num_layers,

dropout)

net = d2l.EncoderDecoder(encoder, decoder)

train_seq2seq(net, train_iter, lr, num_epochs, tgt_vocab, device)

loss 0.019, 12745.1 tokens/sec on cuda:0

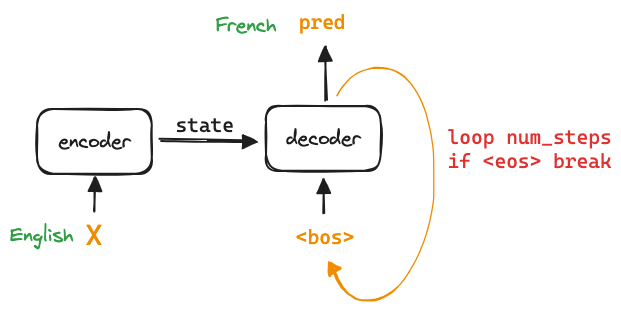

与训练的强制教学不同的是,我们利用上一步的预测,当做下一时刻的输入,如此循环 num_steps 次做预测,遇到 <eos> 停止,而最初 decoder 的输入就是 <bos>

seq2seq 整体预测框架

seq2seq 整体预测框架

#@save

def predict_seq2seq(net, src_sentence, src_vocab, tgt_vocab, num_steps,

device, save_attention_weights=False):

"""序列到序列模型的预测"""

# 在预测时将net设置为评估模式

net.eval()

src_tokens = src_vocab[src_sentence.lower().split(' ')] + [

src_vocab['<eos>']]

enc_valid_len = torch.tensor([len(src_tokens)], device=device)

src_tokens = d2l.truncate_pad(src_tokens, num_steps, src_vocab['<pad>'])

# 添加批量轴

enc_X = torch.unsqueeze(

torch.tensor(src_tokens, dtype=torch.long, device=device), dim=0)

enc_outputs = net.encoder(enc_X, enc_valid_len)

dec_state = net.decoder.init_state(enc_outputs, enc_valid_len)

# 添加批量轴

dec_X = torch.unsqueeze(torch.tensor(

[tgt_vocab['<bos>']], dtype=torch.long, device=device), dim=0)

output_seq, attention_weight_seq = [], []

for _ in range(num_steps):

Y, dec_state = net.decoder(dec_X, dec_state)

# 我们使用具有预测最高可能性的词元,作为解码器在下一时间步的输入

dec_X = Y.argmax(dim=2)

pred = dec_X.squeeze(dim=0).type(torch.int32).item()

# 保存注意力权重(稍后讨论)

if save_attention_weights:

attention_weight_seq.append(net.decoder.attention_weights)

# 一旦序列结束词元被预测,输出序列的生成就完成了

if pred == tgt_vocab['<eos>']:

break

output_seq.append(pred)

return ' '.join(tgt_vocab.to_tokens(output_seq)), attention_weight_seq

前面都是在处理输入 encoder 的输入和对 <bos> 降维,后面对 <bos>作为输入,不断一步一步预测

21 行这里有个 bug,与训练时架构设计不一致,训练时每步输入的 context 是从 encoder 的 state来的,对每个时间步是一样的,是多步训练

而预测是单步的,循环使用同一个 state 变量,每个时间步的 context 改变了,与图 [[9.7. 序列到序列学习(seq2seq).png]] 不一致,预测时候的架构是:

![[9.7. 序列到序列学习(seq2seq)-6.png]]

可以参考 讨论帖 中实现的代码,单步预测的时候,每步输入的 Y cat 的应该是 encoder 最开始传进来的同一个张量

预测一个句子,很可能和真实句子的长度不一样,简单截取到相同长度这种做法很粗糙,在机器翻译最常用的做法是计算 BLEU 值(bilingual evaluation understudy),考虑如下序列:

BLEU 的定义:

def bleu(pred_seq, label_seq, k): #@save

"""计算BLEU"""

pred_tokens, label_tokens = pred_seq.split(' '), label_seq.split(' ')

len_pred, len_label = len(pred_tokens), len(label_tokens)

score = math.exp(min(0, 1 - len_label / len_pred))

for n in range(1, k + 1):

num_matches, label_subs = 0, collections.defaultdict(int)

for i in range(len_label - n + 1):

label_subs[' '.join(label_tokens[i: i + n])] += 1

for i in range(len_pred - n + 1):

if label_subs[' '.join(pred_tokens[i: i + n])] > 0:

num_matches += 1

label_subs[' '.join(pred_tokens[i: i + n])] -= 1

score *= math.pow(num_matches / (len_pred - n + 1), math.pow(0.5, n))

return score

把预测出来的结果计算 BLEU 值:

engs = ['go .', "i lost .", 'he\'s calm .', 'i\'m home .']

fras = ['va !', 'j\'ai perdu .', 'il est calme .', 'je suis chez moi .']

for eng, fra in zip(engs, fras):

translation, attention_weight_seq = predict_seq2seq(

net, eng, src_vocab, tgt_vocab, num_steps, device)

print(f'{eng} => {translation}, bleu {bleu(translation, fra, k=2):.3f}')

go . => va !, bleu 1.000

i lost . => j'ai perdu ., bleu 1.000

he's calm . => il est riche ., bleu 0.658

i'm home . => je suis en retard ?, bleu 0.447

可以看到效果一般,bleu 值不算大